雖然同為迴歸模型,

但是兩模型處理的問題並不同,

線性迴歸處理目標值為「數值型」,

羅吉斯迴歸處理目標值為「類別型」。

| 線性 | 羅吉斯 | |

|---|---|---|

| Meaning | 常用於產出結果數字 | 常用於分類(二元或多類別) |

| Label | 數值 | 0-1的機率,二元(True or False) |

| Sample | 我會生出幾個小孩? | 這群小孩,男生的機率? |

參考文章線性迴歸的運作原理,

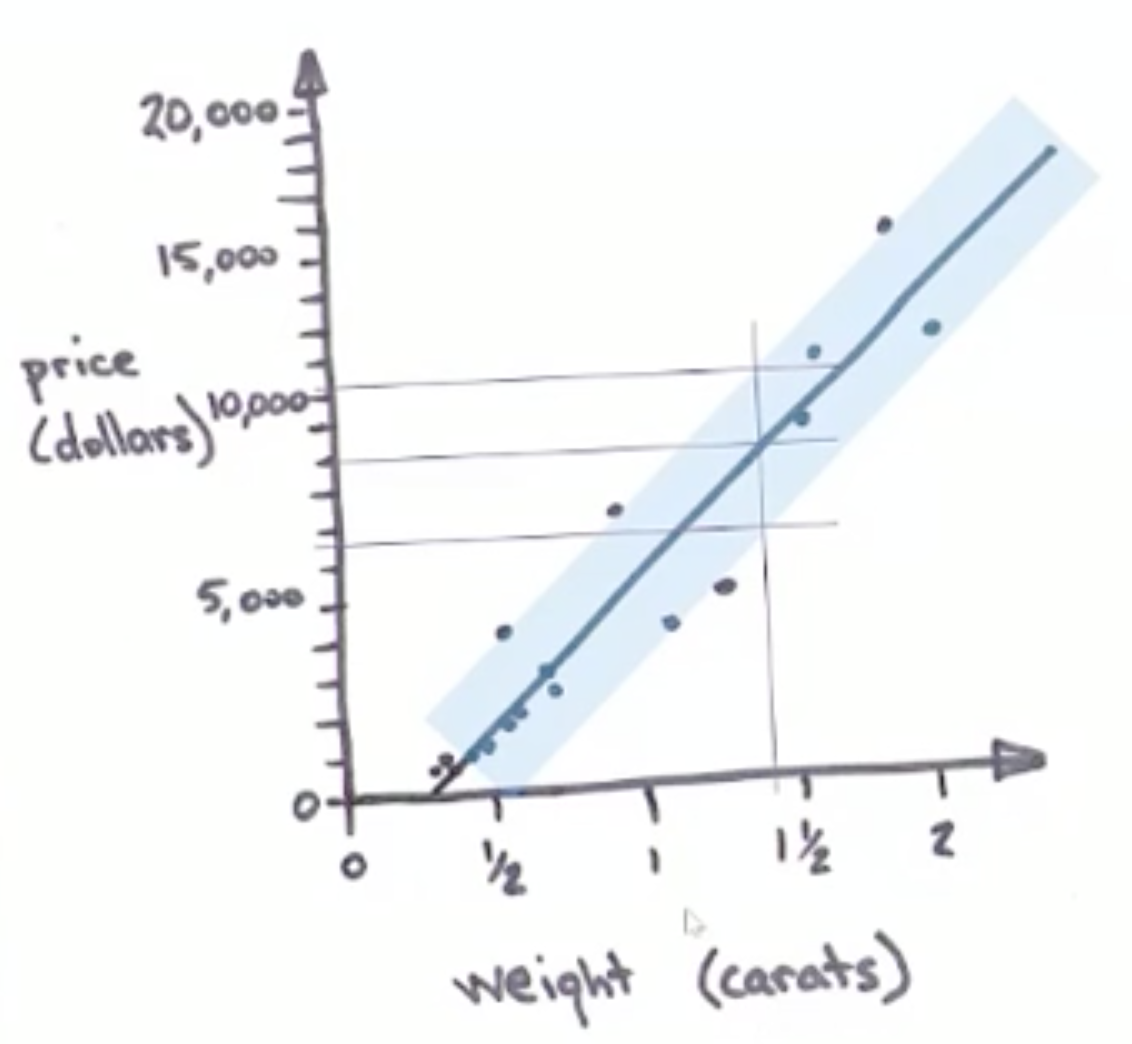

線性迴歸(linear regression)是在資料點中找出規律、畫出一條直線的專業說法。

from sklearn.linear_model import LinearRegression

reg = LinearRegression().fit(X, y)

參考文章第3.3講:線性分類-邏輯斯回歸(Logistic Regression) 介紹,

首現先介紹一下Sigmoid函數,也稱為logistic function,

這個函數的y 的值介於 0~1,

這樣的分布也符合機率是在0~1的範圍中。

from sklearn.linear_model import LogisticRegression

reg = LogisticRegression().fit(X, y)

參考文章回归分析的五个基本假设,

針對假設做說明,可能發生的問題,以及檢測方式。

線性迴歸速度快,

但要注意共線性、標準化問題,

也要注要迴歸的事前假設。

以上,打完收工。